GPU สำหรับ AI ปี 2026: มองให้ไกลกว่า VRAM

ในปี 2026 การเลือก GPU สำหรับ AI เปลี่ยนไปแล้ว ไม่ใช่แค่ดู VRAM 24GB หรือ 48GB แล้วจบ คุณต้องมองที่ architecture ใหม่ที่รองรับ FP4/INT4 precision ด้วย

RTX 50 series มาพร้อม AI cores รุ่นใหม่ที่ optimize เฉพาะ transformer models ส่วน AMD RX 8000 เน้น open-source ecosystem ทำงานร่วมกับ PyTorch และ JAX ได้ลื่นกว่า

สิ่งสำคัญคือ compatibility กับ framework ล่าสุด เพราะ AI tools พัฒนาเร็วมาก ผมว่าในยุคนี้ถ้าซื้อ GPU ที่ไม่รองรับ standard ใหม่ อีก 6 เดือนก็ตกรุ่นแล้ว โฟกัสที่ future-proof มากกว่าแรง compute ตอนนี้

ทำไมการเลือก GPU สำหรับ AI ในปี 2026 ถึงซับซ้อนขึ้น

ปีที่แล้วผมซื้อ RTX 4080 มา train model แต่พอ Llama 4 ออกมา VRAM 16GB ไม่พอรันแบบ full precision ต้องไปหา cloud GPU แทน เสียตังค์เปล่าๆ

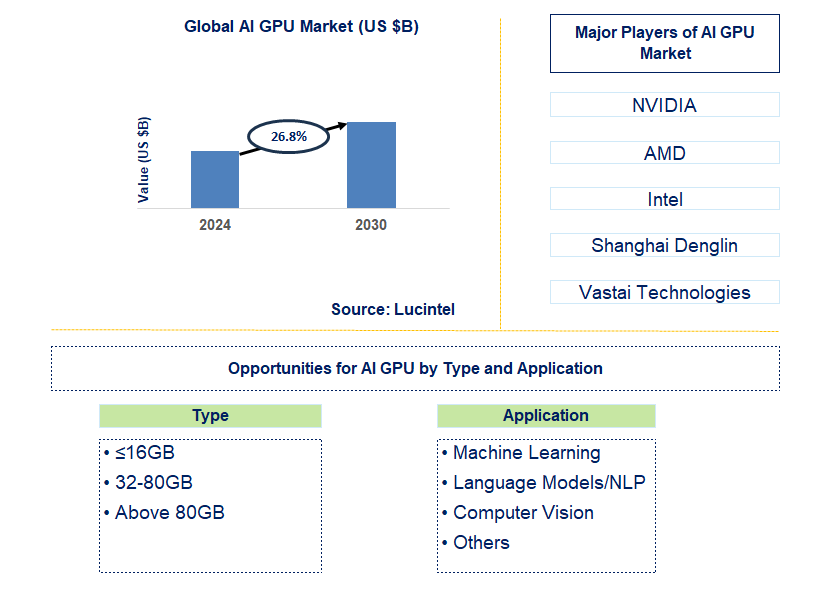

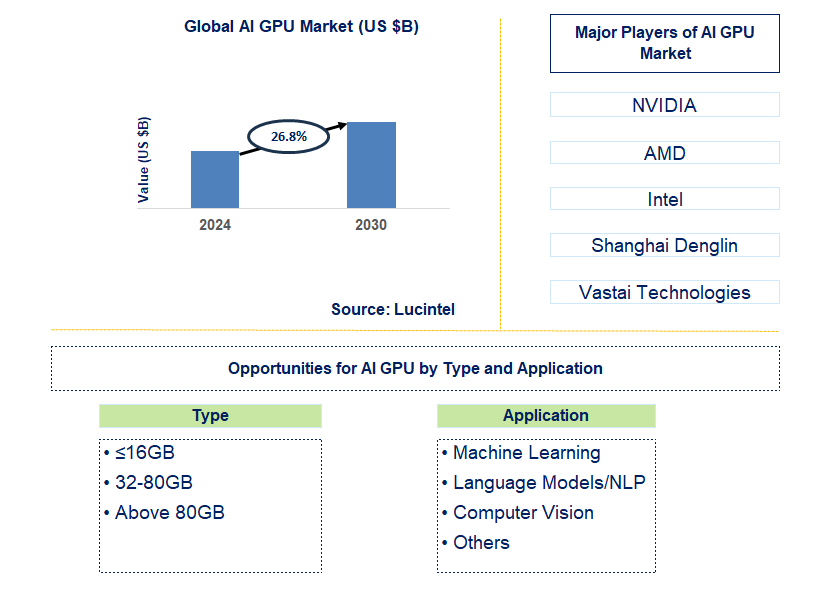

การเลือก GPU ปี 2026 ซับซ้อนกว่าเดิมเพราะ AI models ขยายตัวเร็วมาก จาก 7B parameters กระโดดเป็น 70B ใน 2 ปี Memory requirements เพิ่มขึ้นแบบ exponential แต่ GPU architecture ยังไม่ทันตาม

สิ่งที่ยากที่สุดคือการคาดเดาว่าใน 12-18 เดือนข้างหน้า AI จะต้องการ resources แค่ไหน ถ้าเลือกผิดก็เหมือนซื้อ iPhone รุ่นเก่าราคาเต็ม แล้วรุ่นใหม่ออกเดือนถัดไป งบหมื่นๆ ก็ไปแบบนั้น

ภูมิทัศน์ GPU สำหรับ AI ในปี 2026

ตลาด GPU สำหรับ AI แบ่งออกเป็น 4 tier ชัดเจน Entry-level คือ RTX 4060 กับ RTX 5060 ราคา 15,000-20,000 บาท เล่น small models 7B parameters ได้เฉยๆ

Mid-range เป็น RTX 4070 Ti ถึง RTX 5070 Ti งบประมาณ 25,000-35,000 บาท รัน medium models 13B-30B parameters ได้สบาย High-end คือ RTX 4080 กับ RTX 5080 ราคา 45,000-65,000 บาท handle models 20B-30B parameters ได้สบาย (70B ต้อง quantize หนักหรือใช้ multi-GPU)

Workstation tier เป็น RTX 6000 Ada กับ H100 ราคาหลักแสน สำหรับ enterprise และ research ที่ต้อง 80GB VRAM ขึ้นไป

Tier กลางคือจุด sweet spot สำหรับคนทั่วไป เพราะได้ performance ดี แต่ราคายังไม่บ้า แถม future-proof พอสำหรับ 2-3 ปีข้างหน้า

เปรียบเทียบ GPU รุ่นเก่า เทียบกับ รุ่นใหม่ในปี 2026

| Factor | RTX 40 Series | RTX 50 Series |

|---|---|---|

| ราคา | 45,000-65,000 บาท | ราคาสูงขึ้น 20-30% |

| AI Performance | ดี | AI TOPS สูงขึ้น 2x+ (real-world ~20%) |

| VRAM | 8-24GB (GDDR6X) | 8-32GB (GDDR7) |

| Power Efficiency | TDP ต่ำกว่า | TDP สูงขึ้น ~10% แต่ perf/watt ดีขึ้น |

AMD RX 8000 series เข้าสู่เกมส์ AI แล้วด้วย RDNA 4 ที่มี AI accelerator ใหม่ เปรียบเทียบกับ RX 7000 ที่แทบไม่มี AI feature เลย RX 8800 XT ให้ raster performance ใกล้เคียง RTX 4080 แต่ราคาถูกกว่า

ถ้าไม่เร่งด่วน ควรรอ RTX 50 series เพราะ GDDR7 ให้ memory bandwidth สูงกว่า ช่วย handle large language models ได้ดีกว่ามาก แต่ถ้างบจำกัดก็เอา RTX 4070 Ti Super ยังใช้ได้อีกสัก 2 ปี

GPU แต่ละรุ่นใช้งานจริงเป็นยังไง

VRAM 16GB ขึ้นไป ต้องมีถ้าจะรัน LLM ขนาด 13B-30B parameters แบบ local หรือ fine-tune model ใหญ่ๆ VRAM 12GB พอสำหรับ Stable Diffusion กับ small language models แต่จะติดขัดกับงานหนักกว่านี้

AI cores/Tensor cores มีผลตรงต่อ inference speed เวลารัน ChatGPT-style apps หรือ real-time image generation RTX series ได้เปรียบตรงนี้เพราะมี dedicated hardware สำหรับ AI workloads

Memory bandwidth สูง จำเป็นมากสำหรับ batch processing ภาพหลายร้อยใบพร้อมกัน หรือ training models ขนาดกลาง การ์ด flagship มักได้เปรียบตรงนี้

Power efficiency สำคัญถ้าใช้งาน 24/7 เพราะไฟฟ้าแพงขึ้นเรื่อยๆ RTX 4000 series ยังดีกว่า 3000 series เรื่องประหยัดไฟ แม้ performance จะใกล้เคียงกัน

เปรียบเทียบ NVIDIA เทียบกับ AMD เทียบกับ Intel สำหรับ AI

| Factor | NVIDIA | AMD | Intel |

|---|---|---|---|

| AI Performance | ดีที่สุด | ดีขึ้นเรื่อยๆ | เริ่มต้นได้ |

| Software Support | CUDA แน่นที่สุด | ROCm ปรับปรุงมาเยอะ | oneAPI ใหม่ |

| ราคา | แพงที่สุด | คุ้มค่า | ถูกที่สุด |

NVIDIA ยังครองใจ developer ด้วย CUDA ecosystem ที่แน่น TensorFlow, PyTorch ทำงานได้เนียนสุด แต่ราคาบิดขี้เมา

AMD ปรับปรุง ROCm มาเยอะ performance ต่อบาทดีขึ้น เหมาะกับคนงบจำกัดแต่อยากได้ performance ดีๆ

Intel Arc A-series เป็นตัวเลือกใหม่ ราคาน่าสนใจสำหรับคน hobby ผมว่าถ้าเริ่มต้นเล่น AI ลองดู Intel ก่อนก็ได้ จ่ายไม่เจ็บ

ข้อดี-ข้อเสียของแต่ละตัวเลือก

ข้อดี

- +NVIDIA: ecosystem แน่น ใช้งานได้ทันที ไม่ต้องปวดหัวติดตั้ง

- +AMD: ราคาต่อ performance คุ้มกว่า VRAM เยอะในระดับราคาเดียวกัน

- +Intel Arc: ราคาถูกสุด เหมาะกับคนเริ่มต้นหรือ hobby project

ข้อเสีย

- −NVIDIA: แพงมาก flagship ต้องงบหลักแสน

- −AMD: ROCm ยังปวดหัวบ้าง บาง library ยังไม่ support เต็มที่

- −Intel Arc: driver ยังไม่เสถียร AI workload บางตัวอาจมีปัญหา

สรุปให้เลือกตาม use case จริงๆ ถ้าเล่น hobby หรือเรียน Intel Arc ก็พอ แต่ถ้าทำงานจริงจัง NVIDIA ยังเป็น safe choice สุด พูดตรงๆ AMD เหมาะกับคนที่มี technical skill พอจะแก้ปัญหาได้

ค่าใช้จ่ายที่ซ่อนอยู่นอกเหนือราคา GPU

นอกจากราคา GPU แล้ว ยังมีค่าใช้จ่ายเพิ่มเติมที่หลายคนมองข้าม ค่าไฟเป็นตัวแรกที่ต้องคิด RTX 4090 กิน 450W แค่การ์ดเดียว ยังไม่รวม CPU และ component อื่น

PSU ก็ต้องอัปเกรดใหม่ ถ้าใช้ high-end GPU ต้องใช้ 850W ขึ้นไป cooling system ก็ต้องดีขึ้นด้วย เพราะความร้อนเพิ่มขึ้นเยอะ case ที่ใช้อยู่อาจไม่พอ airflow

Software licensing อีกเรื่อง CUDA toolkit ฟรี แต่ enterprise AI platforms อย่าง NVIDIA AI Enterprise เสียเงิน cloud compute credit ก็ต้องซื้อเพิ่ม ควรเผื่องบไว้อีก 30-50% ของราคา GPU สำหรับค่าใช้จ่ายเหล่านี้ ไม่งั้นจะช็อกตอนเจอบิล

ใครควรซื้อ GPU แบบไหนสำหรับ AI

การเลือก GPU ขึ้นอยู่กับ use case และงบจริงๆ hobbyist ที่เล่น local model หรือเขียน script เล็กๆ น้อยๆ RTX 4060 Ti 16GB ก็เพียงพอ startup ที่ทำ prototype หรือ fine-tuning RTX 4090 หรือ RTX 5080 คุ้มสุด

Researcher ที่ต้องทดลองหลาย model พร้อมกัน H100 หรือ A100 จำเป็น แต่ราคาแพงมาก เช่นเดียวกับ enterprise ที่ deploy production scale ต้องใช้ datacenter GPU แท้ๆ

เหมาะกับ

- Hobbyist ที่เล่น local AI model เบาๆ — RTX 4060 Ti 16GB

- Startup ที่ prototype และ fine-tuning — RTX 4090 หรือ RTX 5080

ลองชั่งน้ำหนักดู

- Researcher งบจำกัดแต่ต้องการ performance สูง — พิจารณา cloud compute แทน

ข้ามได้เลย

- คนที่ใช้แค่ ChatGPT หรือ Claude — ไม่จำเป็นต้องซื้อ GPU เลย ใช้ online service

ถ้างบไม่ถึง 100,000 บาท ใช้ cloud หรือ Google Colab Pro คุ้มกว่า

สรุปและคำแนะนำสุดท้าย

การเลือก GPU สำหรับ AI ในปี 2026 ขึ้นอยู่กับงบและความต้องการจริง งบ 30,000-50,000 บาทเลือก RTX 4060 Ti 16GB หรือ RTX 4070 Super งบ 70,000-120,000 บาทไป RTX 4080 Super หรือ RTX 5070 Ti

สำคัญคือ VRAM ต้องเยอะ เพราะ AI model ใหญ่ขึ้นเรื่อยๆ 16GB คือ minimum สำหรับงานจริงจัง 24GB ขึ้นไปถึงจะสบายใจ

ถ้างบไม่ถึง 100,000 บาท ลองใช้ cloud compute ก่อน Google Colab Pro, RunPod หรือ AWS spot instance อาจคุ้มกว่าซื้อ GPU เอง โดยเฉพาะคนที่ทำ research หรือโปรเจกต์ระยะสั้น

จำไว้ว่า GPU เป็นแค่เครื่องมือ เลือกให้เหมาะกับงานและงบ ไม่จำเป็นต้องไล่ flagship เสมอ